Temps de lecture : 12 minutes

mots-clés : IAG, étude scientifique, itération, test, images, générique, IA to IA, culture

Nombre de pages « équivalent » : 4

Article rédigé avec l’aide de l’IA : oui

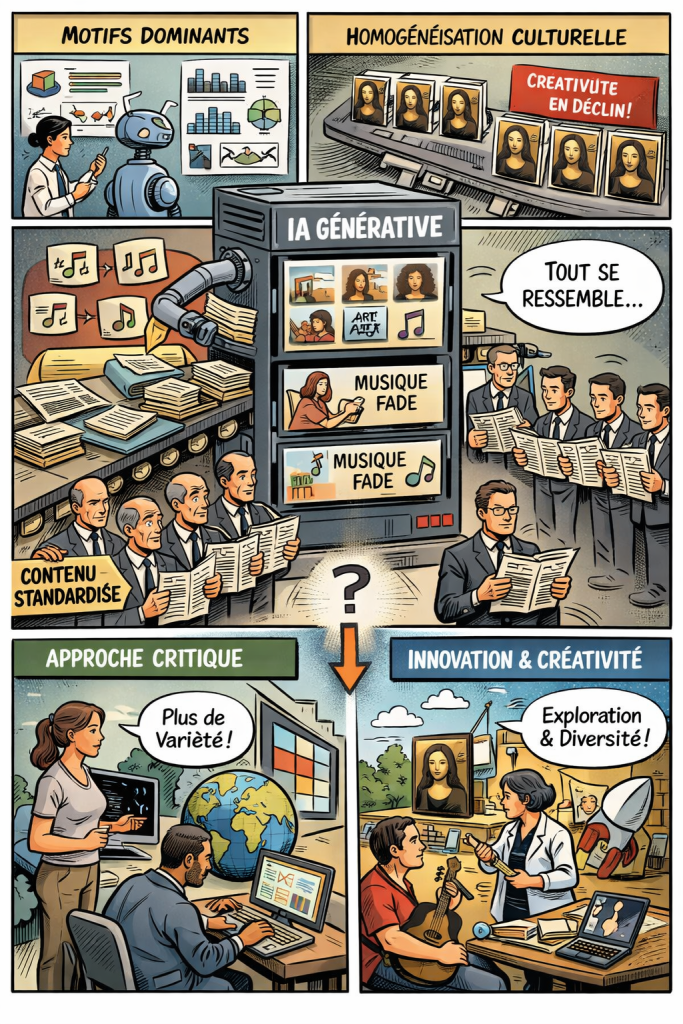

En bref : L’intelligence artificielle générative, fondée sur l’analyse de motifs dans de vastes corpus de données, tend à privilégier les configurations dominantes, ce qui peut conduire à une homogénéisation progressive des contenus culturels et cognitifs (Patterns, 2025 ; Elgammal, 2025). Toutefois, cette dynamique n’est pas intrinsèque à la technologie elle-même, mais dépend fortement des usages, de la diversité des données et des choix de gouvernance. Une approche critique et réflexive est donc essentielle afin que l’IA reste un vecteur d’exploration et de diversité plutôt qu’un facteur de stagnation culturelle. Nous explorons les usages locaux à travers cette étude.

Chers lecteurs, chères lectrices,

introduction

L’intelligence artificielle générative transforme aujourd’hui nos paysages numériques à un rythme inédit, redéfinissant simultanément les modalités de production des connaissances, les pratiques culturelles et les formes de médiation technologique. Mais avant toute chose, expliquons le terme « paysages numériques ». Ce sont les espaces culturels qui intègrent de près ou de loin l’IA. Par exemple, nous pouvons parler des réseaux sociaux, où l’IA est utilisée massivement avec des faux comptes, mais également de manière plus ludique, pour présenter une portion de ville ancienne où les habitants semblent bouger par magie, grâce à quelques matrices algorithmiques. Nous y reviendrons plus tard.

Notre propos, sous le format d’un blog et non d’un article scientifique, s’inscrit dans l’analyse d’une écologie informationnelle complexe où données, infrastructures computationnelles et pratiques sociales interagissent continuellement. À cet effet, deux contributions récentes au début de l’année 2026 — un article scientifique publié dans Patterns et une analyse critique proposée par Ahmed Elgammal dans The Conversation — nous ont inspiré ce texte pour mettre en lumière une tension structurante de la transformation sociale et insidieusement actuelle de la capacité des systèmes d’intelligence artificielle à générer du contenu à grande échelle, ce qui peut mener à une homogénéisation culturelle et cognitive.

Hypothèse des lectures

L’article Autonomous language-image generation loops converge to generic visual motifs (9 janvier 2026) publié dans la revue Patterns (open) s’inscrit dans l’étude sur les systèmes d’apprentissage automatique fondés sur la détection de motifs (patterns) dans de grands ensembles de données. Ces approches reposent sur l’identification de régularités statistiques permettant de générer des contenus plausibles ou prédictifs. Toutefois, les auteurs mettent en exergue dans l’état de l’art et leurs tests que cette logique peut conduire à un phénomène de convergence : les modèles tendent à privilégier les configurations les plus fréquentes dans les données d’entraînement, ce qui peut progressivement réduire la diversité des résultats produits. Mieux, les algorithmes finissent par simplifier et générer le plus commun en ayant oublié les images initiales et leurs originalités.

Cette dynamique est parfois rapprochée du concept de « mode collapse » en apprentissage automatique, où certaines distributions de sortie dominent au détriment de variations plus rares ou innovantes.

Pour comprendre concrètement ce que cela signifie : ils ont travaillé sur un lot d’images pour lesquelles ils ont laissé travailler ensemble plusieurs IAG. La commande initiale est de demander qu’une IAG transforme en texte l’image initiale (image to text) et ensuite, une autre IA transforme ce texte… en image (Text to image). Pour cette dernière, nous sommes certains que vous avez déjà essayé ce procédé sur Chat GPOT ou Gemini plus récemment.

La force de l’étude est d’avoir travaillé sur une masse de données importante, ce qu’on appelle communément des métadonnées (en bon français, big data pour les anglophiles).

Le résultat est interpellant avec la perte complète du sens et la génération finale d’images banales et convergentes vers une forme de PPCM (plus petit commun multiple). À un point tel que l’image initiale n’a plus rien à voir avec l’image finale, non pas par de minimes transformations dues aux erreurs sémantiques, mais bien liées à des biais algorithmiques (de connaissance) des matrices de données.

Cette observation est prolongée par l’analyse d’Ahmed Elgammal (2026), Professeur d’informatique et directeur du laboratoire Art & AI, Université Rutgers qui examine les implications culturelles de l’usage généralisé des systèmes génératifs (AI-induced cultural stagnation is no longer speculation − it’s already happening, 22 janvier 2026). Selon l’auteur, les expériences menées avec des chaînes de génération itératives — où des contenus produits par IAG servent eux-mêmes de nouvelles données d’entrée — montrent une tendance nette à l’uniformisation (le fameux PPCM). Les images ou textes générés deviennent progressivement plus génériques, plus consensuels et moins porteurs de singularité expressive. Elgammal parle d’une esthétique comparable à une « musique d’ascenseur visuelle », agréable, mais pauvre en signification culturelle. Cela pose une véritable question de fond sur la singularité des algorithmes d’apprentissage face à une approche des méta données où, paradoxalement, ce que les scientifiques recherchent le plus souvent dans ces masses de données, ce sont les éléments … qui sortent de l’ordinaire (!) et, selon la granulométrie définie dans les paramètres l’analyse.

Constats

La convergence entre ces deux analyses repose sur un constat commun : les systèmes d’IA apprennent essentiellement à reproduire et combiner des structures existantes. Leur capacité créative, bien que souvent impressionnante, reste fortement dépendante des données historiques disponibles. Lorsque ces données deviennent elles-mêmes influencées par des productions automatisées, un effet de rétroaction peut apparaître, conduisant à une homogénéisation progressive des contenus. Cette hypothèse repose d’abord sur la nature même des modèles d’apprentissage automatique contemporains. Ceux-ci apprennent essentiellement à partir de régularités statistiques extraites de corpus massifs de données. En identifiant des structures récurrentes — qu’il s’agisse de formes visuelles, d’expressions linguistiques ou de configurations narratives — les modèles construisent des représentations probabilistes du monde. L’article publié dans Patterns souligne que, si cette logique de détection de motifs est extrêmement efficace pour la prédiction et la génération, elle tend aussi à privilégier les configurations dominantes au détriment des singularités moins fréquentes. Cette dynamique n’est pas nouvelle dans l’histoire des systèmes d’information, mais l’échelle computationnelle actuelle lui confère une portée culturelle inédite.

Concrètement, c’est une logique de moyenne : si vous avez deux données, +10 et -10 la différence est importante entre ces deux valeurs. Ensuite, si vous mettez 20 autres valeurs entre +10 et -10, inévitablement, la moyenne sera plus proche de +10 ou -10 si les valeurs sont aléatoires. Avec énormément de données, vous avez de grands changes que la moyenne soit égale à 0 si la distribution est homogène entre les valeurs situées entre +10 et -10.

Ce qui nous intéresse d’un point de vue sociologique (de l’impact de l’usage des IAG)

Dans cette perspective, l’analyse d’Elgammal (2025) introduit une dimension socioculturelle essentielle. Les expérimentations qu’il décrit montrent que, lorsque des systèmes génératifs fonctionnent en boucle — produisant des contenus qui deviennent eux-mêmes des données d’entrée — les résultats convergent progressivement vers des formes génériques. Cette convergence ne signifie pas nécessairement une perte totale de qualité, mais plutôt une atténuation des aspérités culturelles, des nuances contextuelles et des innovations stylistiques. Le résultat peut être esthétiquement acceptable tout en étant culturellement appauvri, phénomène que l’auteur qualifie métaphoriquement de « stagnation culturelle induite par l’IA ».

Une lecture inspirée des approches paysagères du numérique invite cependant à dépasser une vision strictement technodéterministe de cette évolution. Les paysages numériques ne sont pas uniquement produits par les technologies ; ils émergent d’interactions complexes entre infrastructures, acteurs humains, régulations institutionnelles et dynamiques économiques. L’IA générative participe à cette recomposition, mais elle n’en constitue qu’un élément parmi d’autres. La standardisation culturelle observée dans certains secteurs médiatiques précède d’ailleurs l’essor de l’intelligence artificielle, liée notamment à la mondialisation des industries culturelles et à la logique algorithmique des plateformes numériques.

Toutefois, la spécificité actuelle réside dans l’automatisation potentielle de la production culturelle elle-même. Lorsque textes, images ou musiques sont générés à grande échelle par des systèmes algorithmiques, ils peuvent progressivement influencer les corpus futurs servant à entraîner de nouveaux modèles. Cette boucle de rétroaction constitue un enjeu majeur pour la diversité culturelle. Elle interroge non seulement la créativité artistique, mais aussi la production scientifique, la communication institutionnelle et même les formes de décision publique fondées sur l’analyse de données.

Pour vous en convaincre, nous allons vous présenter un exemple fréquent que vous avez peut-être déjà rencontré en naviguant sur Facebook sur les pages des villes d’antan : l’IA a permis de voir éclore de nombreuses images des temps plus anciens, souvent du début du 20e siècle, avec des photos de villes et de villages. Ces images sont souvent idéalisées sur le « c’était mieux avant » caractéristique d’une époque marquée par une population vieillissante. L’animation de ces anciennes photos nous a fait passer dans une autre dimension, mais elle présente plusieurs biais : habits semblables, transformation des époques par une généralisation des comportements humains dans la ville, faisant oublier les questions de classe sociale (qu’on ne mélangeait pas) ; généralisation d’un espace public propre, sans oublier la disparition de l’insécurité… invisible à l’œil.

Ces petites séquences de quelques secondes puisent dans la génération par IA à défaut de savoir réellement ce qu’il s’y passait. Toutefois, ces mêmes images diffusées de manière très imaginative sur les réseaux sont souvent particulièrement commentées : « c’était magnifique », « ahah, que c’était bon l’ancien temps dans cette rue », etc., pourtant, l’ensemble de ces commentaires ne représentent aucune des expériences réelles des commentateurs. Toutefois, ces expériences sont intégrées dans les masses de données liées à l’image générée. Un renforcement sémantique pour les algorithmes qui peuvent lier la génération d’images de villes anciennes sur photo à un plaisir nostalgique de plus en plus sériée pour rendre service à l’humain qui a voulu créer cette image et les suivantes. Ainsi, la base de données s’affine pour répondre à une attente plus que de répondre à la réalité du temps qui s’est écoulé.

En conclusion

Une écologie (au sens d’un système qui s’autoalimente de manière systémique) critique des données suppose dès lors d’examiner la qualité et la provenance des corpus utilisés pour entraîner les systèmes d’intelligence artificielle. La diversité culturelle et cognitive dépend en grande partie de la diversité des données disponibles et de leur sériage interagissant avec l’humain. Si ces données deviennent progressivement homogénéisées — qu’il s’agisse de textes standardisés, d’images générées ou de contenus optimisés pour les algorithmes de recommandation — les systèmes futurs risquent de reproduire et d’amplifier cette homogénéisation.

Cependant, cette perspective ne doit pas occulter les potentialités positives de l’intelligence artificielle générative. Ces technologies peuvent également favoriser l’exploration créative, la simulation prospective et la démocratisation de l’accès à certains outils de production culturelle. Elles offrent la possibilité de représenter des scénarios complexes, de concevoir des prototypes rapidement ou de faciliter l’expression de publics qui n’étaient pas suffisamment représentés dans les industries culturelles traditionnelles. C’est le cas de la transformation des dites images /photos anciennes des villes. Le risque de stagnation culturelle n’est donc pas intrinsèque à la technologie elle-même, mais dépend largement des conditions sociales, économiques et politiques de son déploiement et d’un accompagnement continu par le développement, en parallèle de la culture. Ainsi, le travail sur les animations de vieilles photos ne pose pas de problème… pour autant qu’en parallèle de véritables expositions sur les conditions de vie dans les villes au début du 20e siècle soient produites pour le plus grand nombre.

La question devient alors celle de la gouvernance de ces nouveaux paysages numériques hybrides. Comment concevoir des systèmes d’intelligence artificielle favorisant la diversité plutôt que l’uniformité ? Plusieurs pistes émergent : diversification volontaire des corpus d’entraînement, transparence accrue sur les sources de données, intégration de mécanismes favorisant l’exploration plutôt que la seule optimisation, mais le plus crédible aujourd’hui sont le maintien d’un rôle critique fort des acteurs humains dans la production culturelle. Ces stratégies relèvent autant de choix techniques que de décisions politiques et institutionnelles. Rappelons qu’aujourd’hui, la culture est mise sur la sellette un peu partout par des pouvoirs autoritaires ou populistes…

En définitive, l’intelligence artificielle générative ne doit pas être envisagée uniquement comme un outil de production automatisée, mais comme un élément structurant des paysages culturels contemporains. Les deux articles conjoints que nous mettons aujourd’hui en lumière soulignent un risque réel d’homogénéisation, mais elles rappellent également que ce risque dépend étroitement des usages, des politiques de données et des pratiques sociales. Une approche réflexive et interdisciplinaire apparaît indispensable pour accompagner cette transformation, afin de préserver la diversité culturelle tout en exploitant les potentialités créatives offertes par ces technologies. Ainsi, plutôt qu’une stagnation culturelle inévitable, l’enjeu réside probablement dans la capacité collective à construire une écologie du numérique équilibrée, où l’intelligence artificielle devient un outil d’exploration et de pluralité plutôt qu’un vecteur d’uniformisation.

Bonne et belle journée à vous.

pour aller plus loin :

Elgammal, A. (2025). AI-induced cultural stagnation is no longer speculation — it’s already happening. The Conversation. https://theconversation.com/ai-induced-cultural-stagnation-is-no-longer-speculation-its-already-happening-272488

Patterns Editorial Article. (2025). Article on AI pattern convergence and generative modeling dynamics. Patterns (Cell Press). https://www.cell.com/patterns/fulltext/S2666-3899(25)00299-5

Merci pour le suivi de notre blog-à-idées ou à réflexions, c’est toujours agréable d’être lu et vous êtes de plus en plus nombreux (+ de 1 000 par mois en, moyenne). N’hésitez pas à commenter, c’est aussi une place de débats. Et surtout, merci de partager/liker si vous soutenez nos réflexions ou recherches. C’est un véritable soutien de votre part et il est apprécié à sa juste valeur.

Dr. Pascal SIMOENS, Architecte et urbaniste, data Scientist.

J’ai commencé ma vie en construisant des villes en Lego, j’en ai fait mon métier. Geek invétéré, aujourd’hui je joins mes passions du numérique et de la ville au travers d’une expertise smart Cities et smart-buildings comme responsable » R&D au sein du groupe Pirnay (Charleroi-Bruxelles) et plus particulièrement de sa section S²Enginnering (smart & sustainable) . En même temps, j’enseigne cette expertise et continue la recherche dans les domaines de l’IA, l’architecture et la réduction de l’entropie du processus constructif au sien de l’UMONS. Je représente également les universités d’Etat de la communauté Française au sein du Conseil National de l’Ordre des architectes et du Conseil francophone et germanophone.

This post is licensed under a Creative Commons Attribution-NonCommercial 4.0 International License.